Die Technologiewelt konzentrierte sich einst nur auf PC-Hardware und Konsolen-News. Dann übernahmen Smartphones den Sektor. Heute drehen sich fast alle Schlagzeilen um Künstliche Intelligenz. Nicht nur die Nachrichten, sondern die Technologie selbst konsumiert dieses Thema intensiv. Einer der Bereiche, in denen dieser Konsum am stärksten zu spüren ist, ist der Speichermarkt.

Die Nachfrage nach DRAM-Derivaten, die GPUs und Beschleuniger in KI-Rechenzentren speisen, ist so stark gestiegen, dass das Angebot für andere Bereiche schrumpfte und die Preise in die Höhe schnellten. Laut Counterpoint Research stiegen die DRAM-Preise allein im laufenden Quartal um 80 bis 90 Prozent.

Obwohl große KI-Hardwarehersteller angeben, ihre Chip-Versorgung bis 2028 gesichert zu haben, stehen PC-Hersteller und Unterhaltungselektronik-Marken vor einem begrenzten Angebot und steigenden Kosten. Wie kam der Sektor an diesen Punkt und wie nah ist ein Ausweg?

Experten zufolge ist das aktuelle Bild das Ergebnis des Zusammentreffens des historischen „Boom and Bust“-Zyklus des DRAM-Sektors mit beispiellosen Investitionen in die KI-Infrastruktur. Selbst wenn neue Kapazitäten entstehen, könnte es Jahre dauern, bis das Angebot die Nachfrage einholt. Solange es keinen massiven Einbruch bei der KI gibt, bleiben die Preise voraussichtlich hoch.

Was ist HBM und warum ist es so kritisch?

Das Hauptelement, das das Gleichgewicht zwischen Angebot und Nachfrage stört, ist die HBM-Technologie (High Bandwidth Memory). HBM basiert auf einem dreidimensionalen Chip-Packaging-Ansatz, den die DRAM-Industrie gegen die nachlassende Dynamik des Mooreschen Gesetzes entwickelt hat.

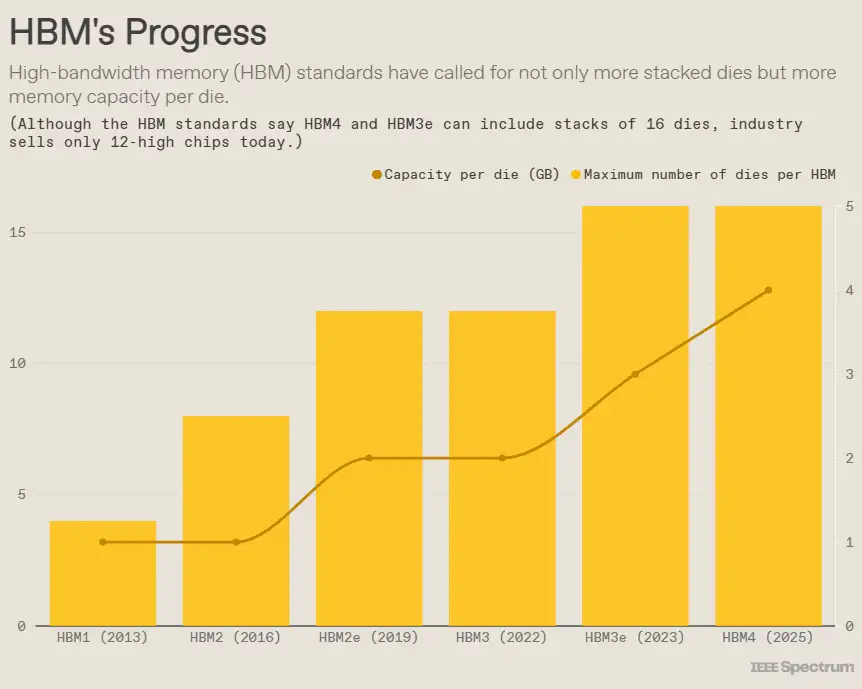

Ein HBM-Chip besteht aus bis zu 12 übereinander gestapelten DRAM-Schichten, sogenannten „Dies“. Jede Schicht enthält vertikale Verbindungen durch das Silizium (TSV). Diese Schichten sind durch mikroskopisch kleine Lötkugeln miteinander verbunden. Die etwa 750 Mikrometer dicke Struktur sitzt auf einer Basisschicht, die den Datenfluss verwaltet.

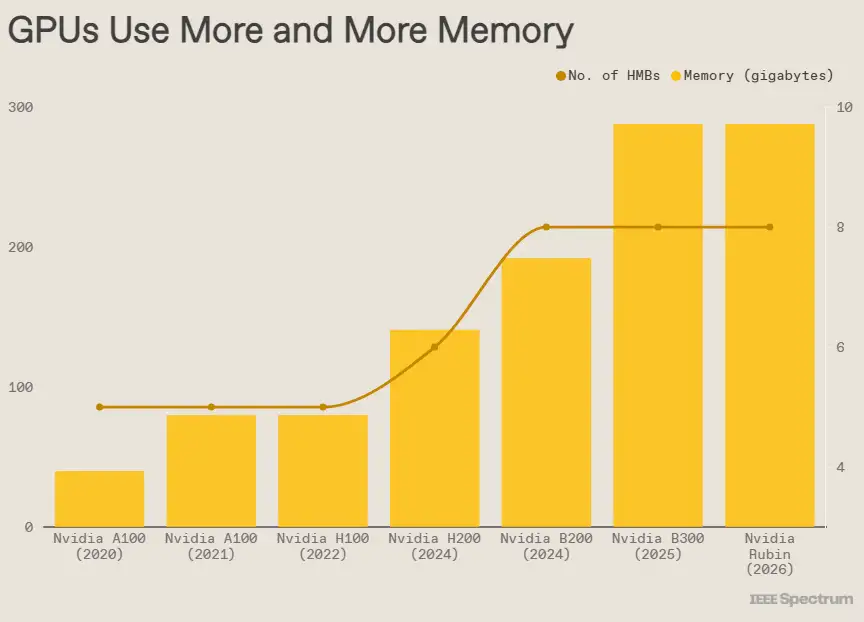

Diese komplexe Struktur wird nur wenige Millimeter von der GPU entfernt platziert, wobei bis zu 2.048 Verbindungen entstehen. HBM-Module werden oft zusammen mit der GPU in einem einzigen Paket angeboten.

Ziel dieser dichten Verbindung ist es, die „Speicherwand“ zu überwinden. Für große Sprachmodelle (LLM) ist ein Datenfluss in Terabyte-Größe pro Sekunde zur GPU entscheidend. Die Speicherbandbreite ist einer der Hauptfaktoren für die LLM-Leistung.

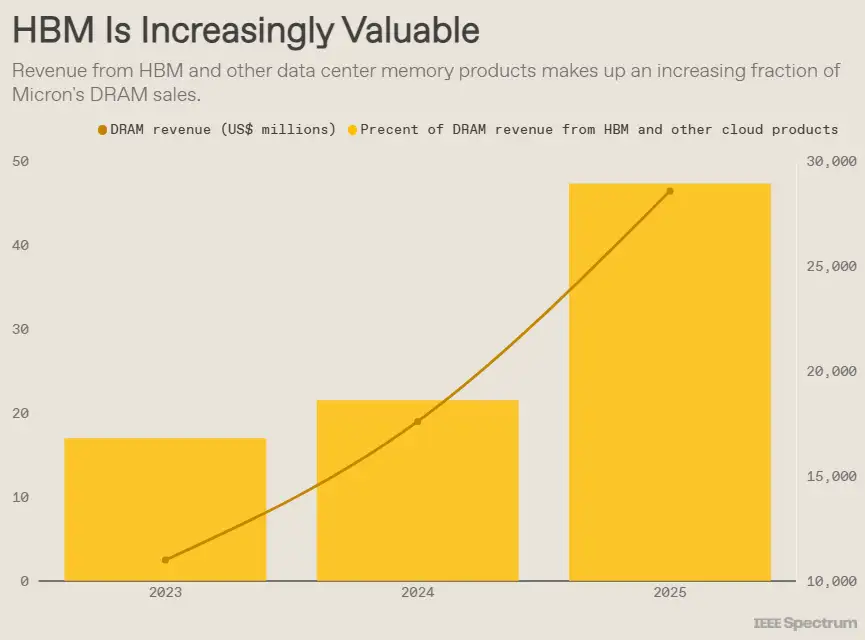

HBM ist seit über einem Jahrzehnt auf dem Markt, aber mit der Größe der KI-Modelle stieg seine Bedeutung dramatisch. Der Preis ist hoch: Laut SemiAnalysis ist HBM etwa dreimal teurer als herkömmlicher Speicher und kann über 50 Prozent der Kosten einer verpackten GPU ausmachen.

Zyklische Struktur

Der DRAM-Sektor ist hochgradig zyklisch. Da die Kosten für große Fabriken (Fabs) über 15 Milliarden Dollar liegen können, sind Unternehmen bei Kapazitätserweiterungen vorsichtig. Solche Investitionen werden meist nur in Hochprofitphasen finanziert.

Der Bau einer neuen Fabrik dauert mindestens 18 Monate. Dies führt oft dazu, dass neue Kapazitäten erst nach dem ersten Nachfrageboom online gehen, was ein Überangebot schafft und die Preise drückt.

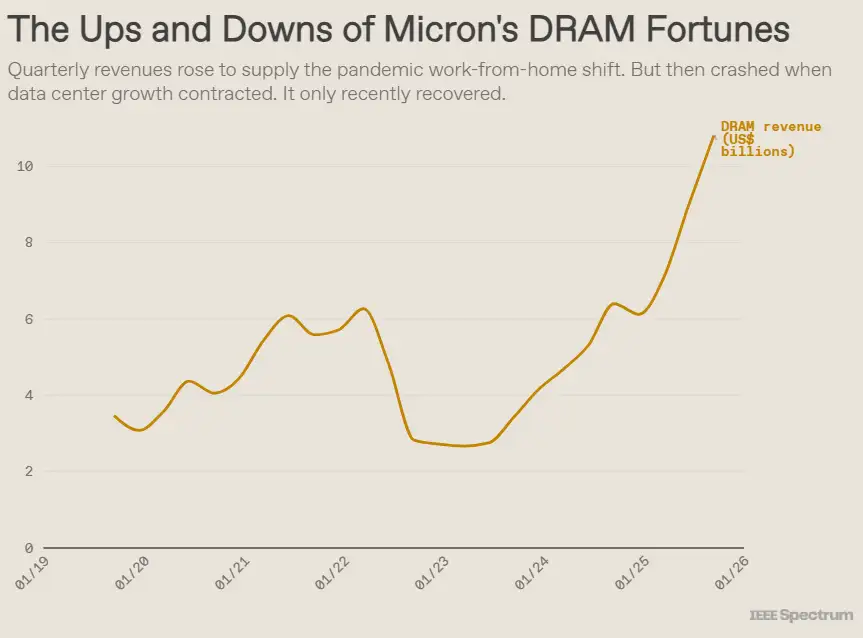

Der aktuelle Zyklus begann in der COVID-19-Ära. Hyperscale-Unternehmen wie Amazon, Google und Microsoft legten große Vorräte an, was die Preise trieb.

Im Jahr 2022 fielen die Preise durch eine Verlangsamung der Investitionen. Hersteller wie Samsung drosselten die Produktion um 50 Prozent. Während 2024 und 2025 die Neuinvestitionen begrenzt blieben, explodierte die Nachfrage durch KI-Rechenzentren.

Laut Data Center Map sind weltweit etwa 2.000 neue Rechenzentren in Planung oder im Bau, was einer Steigerung der globalen Kapazität um 20 Prozent entspricht.

7 Billionen Dollar an Ausgaben erwartet

Laut McKinsey werden Unternehmen bis 2030 rund 7 Billionen Dollar für Rechenzentren ausgeben. Ein Großteil davon entfällt auf Server, Speichersysteme und Netzwerkgeräte.

Nvidia profitierte massiv; der Umsatz im Bereich Rechenzentren erreichte im Oktober 2025 51 Milliarden Dollar. Neue GPUs wie die B300 oder die AMD MI350 nutzen acht 12-lagige HBM-Chips, was den Bedarf weiter erhöht.

Micron gab bekannt, dass der HBM-Anteil am DRAM-Umsatz bis 2025 fast 50 Prozent erreichen wird. Der HBM-Markt soll bis 2028 auf 100 Milliarden Dollar anwachsen – mehr als der gesamte DRAM-Markt von 2024.

Wohin geht die Technologie?

Aufgrund der Schwierigkeiten bei der Skalierung setzen Hersteller auf fortschrittliche Packaging-Technologien. Dies führt zu mehr DRAM-Schichten und damit zu einem höheren Gesamtsilikonverbrauch.

Micron plant den Produktionsstart in Singapur und Taiwan für 2027. Ein neuer Komplex in New York wird erst 2030 die volle Kapazität erreichen. Samsung und SK Hynix erwarten Produktionsstarts für neue Werke erst zwischen 2027 und 2028.

Intel-CEO Lip-Bu Tan betonte, dass vor 2028 keine Entspannung zu erwarten sei. Solange der Hunger nach Rechenleistung unersättlich bleibt, wird es dauern, bis die Preise trotz steigendem Angebot sinken.

Technologien wie HBM4 mit 16 Schichten und „Hybrid Bonding“ werden die Leistung weiter steigern. Samsung und SK Hynix arbeiten bereits an HBM5- und HBM6-Standards, was die Nachfrage nach DRAM weiter antreiben dürfte.