Nach der Einführung des neuesten Codex-Modells Anfang dieses Monats hat OpenAI nun eine neue Version implementiert, die sich auf eine noch schnellere Antwortgenerierung konzentriert. Das neue Modell mit dem Namen GPT-5.3-Codex-Spark wird vom Unternehmen als eine kleinere und leichtere Version der Hauptversion beschrieben. Was Spark jedoch besonders bemerkenswert macht, ist nicht nur die Modelloptimierung, sondern die dahinterstehende spezielle Hardware-Infrastruktur.

Erster konkreter Schritt des 10-Milliarden-Dollar-Deals

Mit dieser Version hat OpenAI eine wichtige Schwelle im Hardwarebereich überschritten und den Spezialchip des langjährigen Partners Cerebras in sein System integriert. Damit wurde die Integration zwischen Software und physischer Infrastruktur auf eine neue Ebene gehoben.

Die Partnerschaft zwischen OpenAI und Cerebras wurde im vergangenen Monat öffentlich bekannt gegeben. Der Ankündigung zufolge wurde zwischen den Parteien ein mehrjähriger Vertrag im Wert von über 10 Milliarden US-Dollar unterzeichnet. OpenAI erklärte zum damaligen Zeitpunkt, dass das Hauptziel der Einbindung von Cerebras in bestehende Rechenlösungen darin bestehe, die Antwortzeiten von KI-Systemen erheblich zu verkürzen.

Riesiger Chip mit 4 Billionen Transistoren

Die Hardwareleistung hinter GPT-5.3-Codex-Spark stammt von Cerebras' Wafer Scale Engine 3 (WSE-3), einem Wafer-Scale-Megachip der dritten Generation. Dieser gigantische Chip beherbergt stolze 4 Billionen Transistoren. Der WSE-3 wurde speziell entwickelt, um hohe Leistung in Workflows zu erbringen, die extrem niedrige Latenzzeiten erfordern. Dieser Chip wurde erstmals im Jahr 2024 vorgestellt.

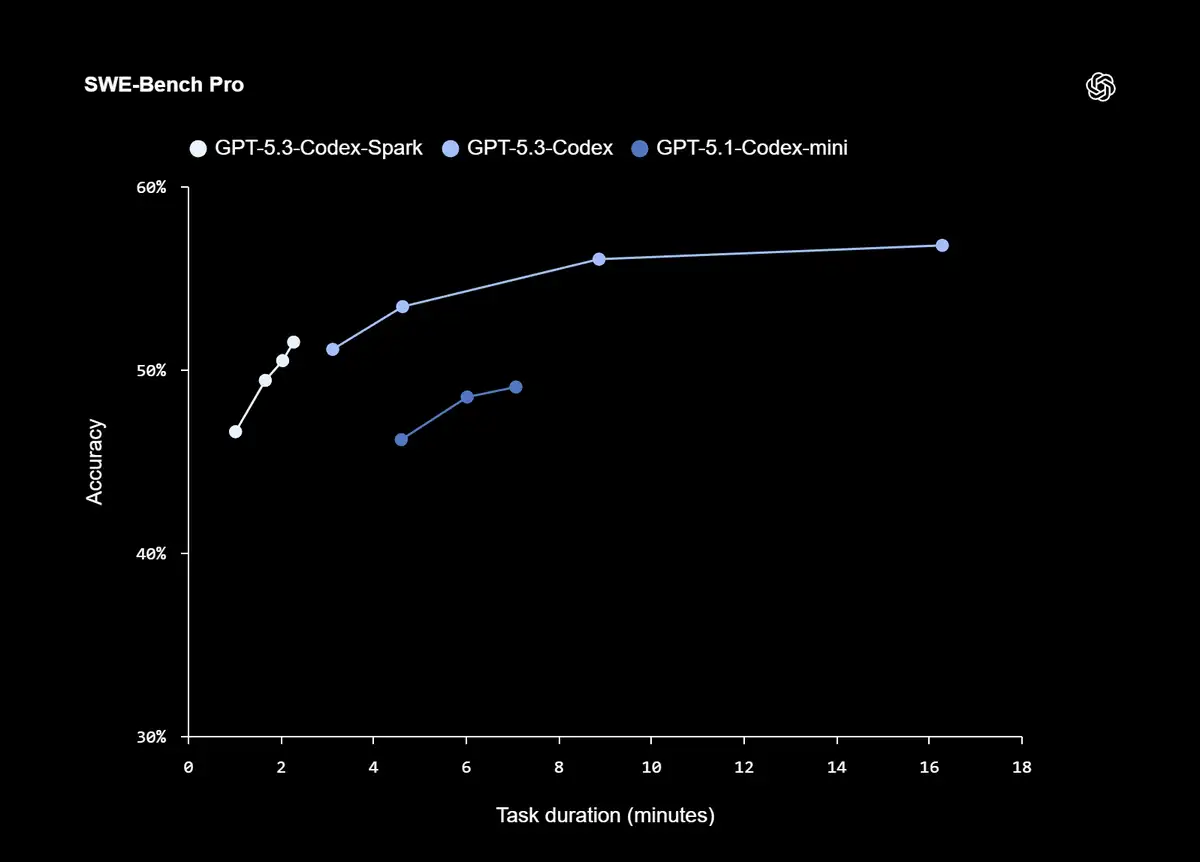

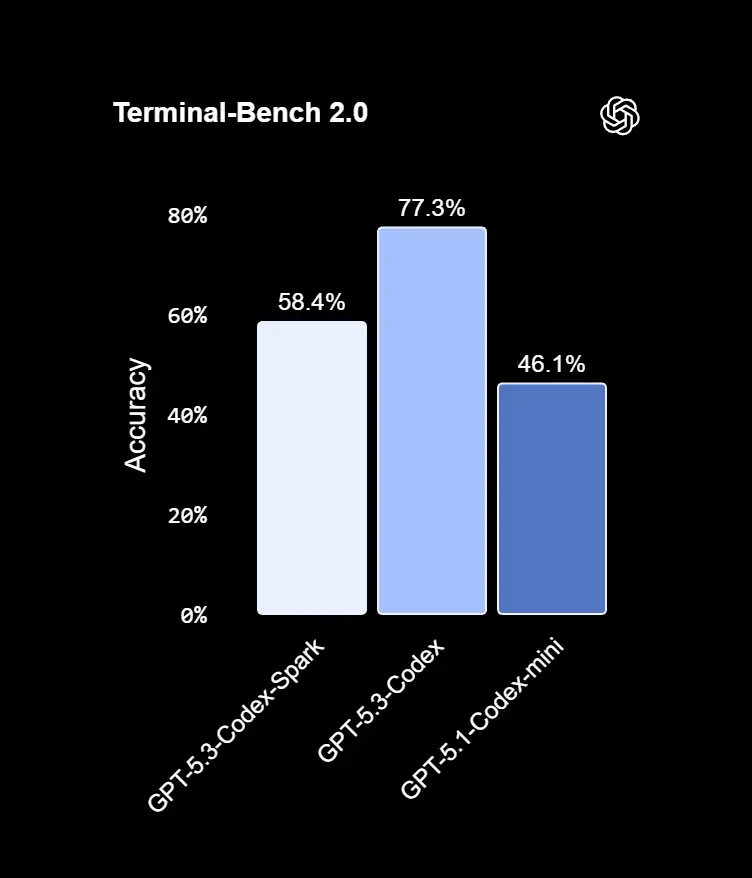

OpenAI definiert die Spark-Version eher als Werkzeug zur Steigerung der täglichen Produktivität denn als Tool für lange und schwere Aufgaben. Laut dem Unternehmen wird dieses neue Modell insbesondere bei schnellen Prototyping-Prozessen und der Echtzeit-Zusammenarbeit glänzen. Umfassendere Aufgaben, die eine längere Dauer und tiefergehende logische Schlussfolgerungen erfordern, bleiben weiterhin im Fokus des Standardmodells GPT-5.3-Codex.

Spark ist derzeit für ChatGPT Pro-Nutzer über die Codex-App im Rahmen einer Research Preview zugänglich.

OpenAI gestaltet die Zukunft von Codex über zwei komplementäre Arbeitsmodi. Demnach wird das System einerseits Möglichkeiten zur Zusammenarbeit in Echtzeit mit geringer Latenz bieten, während es andererseits die Kapazität behält, langfristige und komplexe Aufgaben zu erfüllen.

Das Unternehmen betont, dass das mit dem Ziel der „geringstmöglichen Latenz“ entwickelte Codex-Spark der erste Schritt dieser Vision ist. Es wird angegeben, dass Cerebras-Chips eine starke Performance insbesondere in Workflows bieten, die eine extrem niedrige Latenz erfordern.