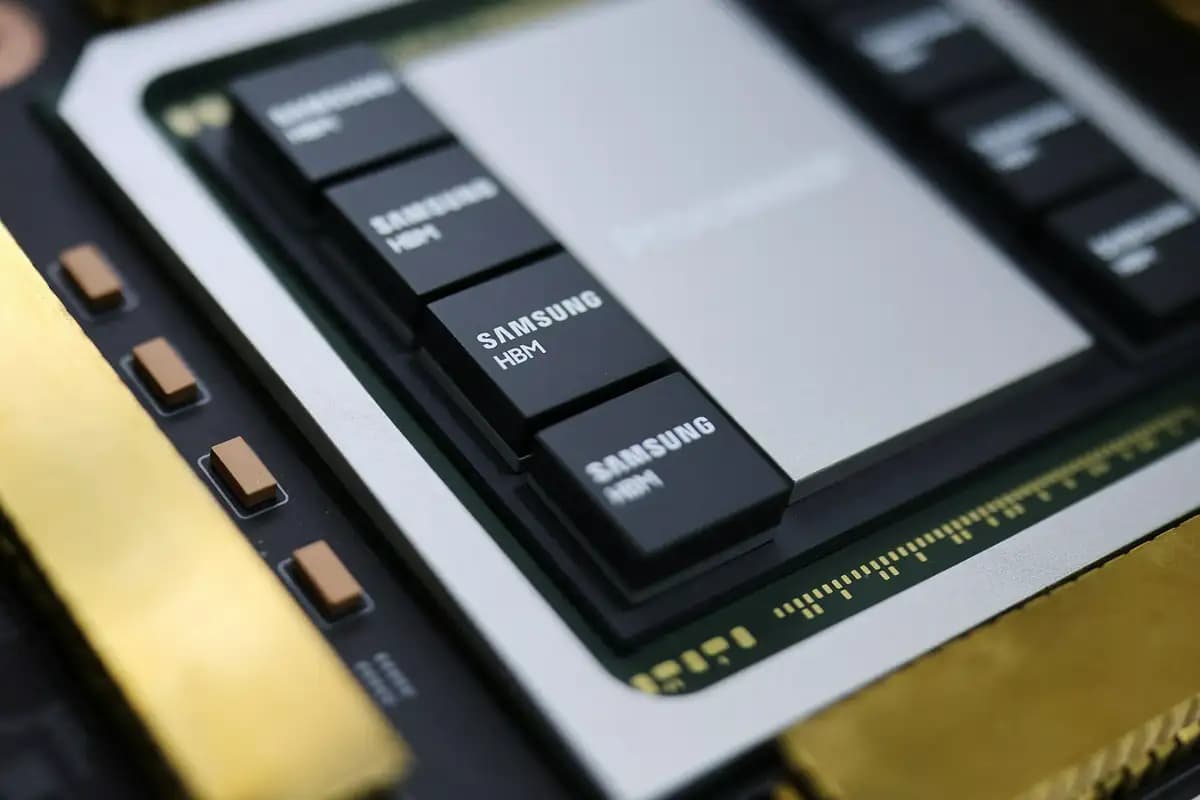

Samsung bereitet Berichten zufolge den Beginn der Massenproduktion seiner High-Bandwidth Memory-Chips der sechsten Generation (HBM4) noch in diesem Monat vor. Dieser Schritt, der in der Halbleiterindustrie als kritische Schwelle gilt, bedeutet, dass das Unternehmen eine seiner wichtigsten Speichertechnologien für KI-fokussierte Hardware in die Fertigungslinien bringt. Es wird erwartet, dass die HBM4-Speicher in Nvidias nächster KI-Beschleuniger-Plattform, Vera Rubin, zum Einsatz kommen.

Die entscheidende Komponente für KI

Berichten aus Südkorea zufolge könnte Samsung bereits in diesem Monat mit der Auslieferung der HBM4-Chips beginnen. Dieser Zeitplan steht im Einklang mit zuvor veröffentlichten Produktionsplänen. Die HBM4-Module sollen in Nvidias GPUs mit Rubin-Architektur verwendet werden. Diese GPUs wurden speziell für Server und große Rechenzentren entwickelt, die auf generative KI-Anwendungen spezialisiert sind.

Es wird betont, dass Samsung im Vorfeld erhebliche Investitionen getätigt hat, um die HBM4-Produktionskapazitäten zu erhöhen. Das Unternehmen hat den Zeitplan beschleunigt, um Nvidias Nachfrage nach frühzeitigem Zugriff gerecht zu werden. SK Hynix hatte seinen Plan für die HBM4-Serienproduktion zuvor von Februar auf März oder April 2026 verschoben.

Samsung gilt damit als das erste Unternehmen, das die Massenproduktion von HBM4 aufnimmt. Sollte sich dies bestätigen, könnte das Unternehmen den bisherigen Marktführer SK Hynix überholt haben. Bei den vorherigen Generationen HBM3 und HBM3E lag Samsung noch hinter SK Hynix zurück.

Aktuelle KI-Beschleuniger wie der AMD MI350 und der Nvidia B200 nutzen HBM3E-Speicher der fünften Generation. In diesem Bereich waren bisher Micron und SK Hynix die dominierenden Lieferanten, während Samsung nur einen begrenzten Marktanteil hielt.

Den Informationen nach haben Samsungs HBM4-Speicher die finalen Validierungs- und Testprozesse von Nvidia erfolgreich bestanden. Daraufhin soll Nvidia offizielle Bestellungen bei Samsung aufgegeben haben. Der HBM4-Speicher von Samsung soll Datenverarbeitungsgeschwindigkeiten von bis zu 11,7 Gigabit pro Sekunde erreichen und damit den JEDEC-Standard von 8 Gbps um 37 % übertreffen. Im Vergleich zu HBM3E wird eine Verbesserung von 22 % erwartet. Die Speicherbandbreite pro Stack wird bis zu 3 Terabyte pro Sekunde erreichen, was dem 2,4-fachen des Vorgängers entspricht.