Der Technologiegigant Microsoft hat seine neueste Hardware angekündigt, die den Anspruch im Bereich der künstlichen Intelligenz auf ein neues Niveau hebt. Der speziell für Azure-Cloud-Dienste und große Sprachmodelle entwickelte Microsoft Maia 200 Chip zielt darauf ab, einen neuen Standard in der KI-Rechenleistung zu setzen. Diese Entwicklung ist das deutlichste Zeichen für Microsofts Bestreben, sowohl die eigene KI-Infrastruktur zu stärken als auch einen strategischen Vorteil gegenüber den größten Wettbewerbern der Branche zu erlangen.

Der Maia 200 baut auf dem im letzten Jahr vorgestellten Modell Maia 100 auf und bietet erhebliche Verbesserungen. Er ist nicht nur ein Hardware-Update, sondern auch ein Beweis dafür, wie ernst es Microsoft im intensivierenden Wettbewerb um KI-Chips meint. Mit diesem Schritt zielt das Unternehmen darauf ab, die Abhängigkeit von externen Anbietern zu verringern und das eigene Ökosystem effizienter und leistungsstärker zu gestalten.

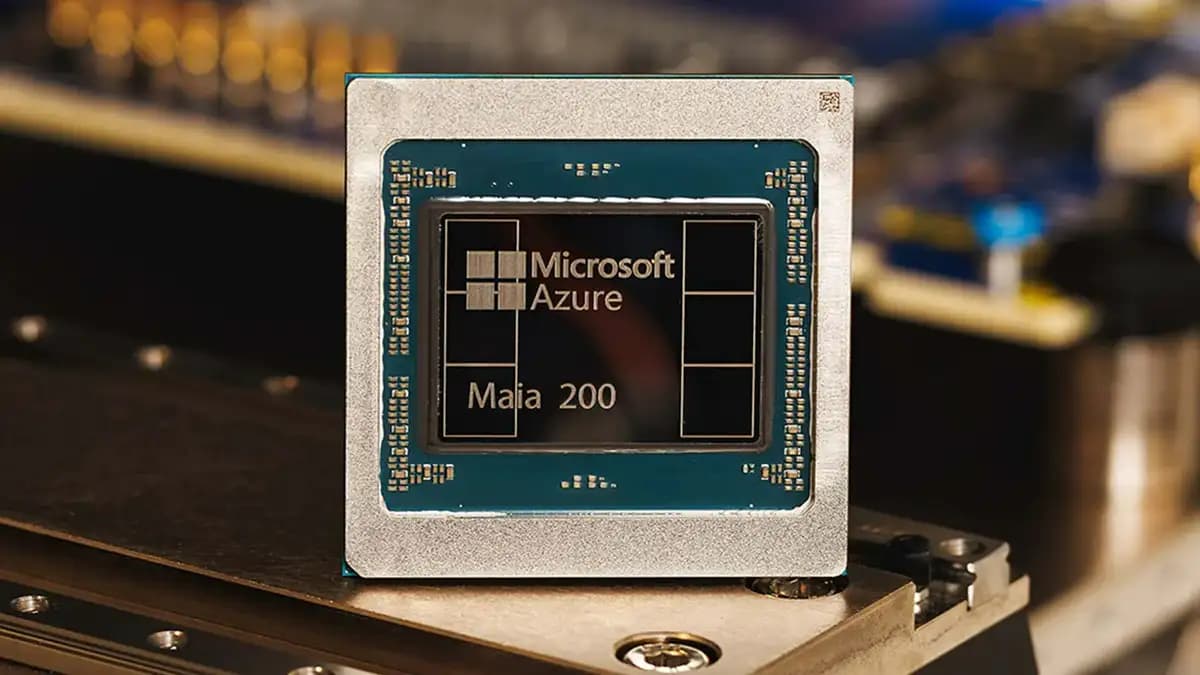

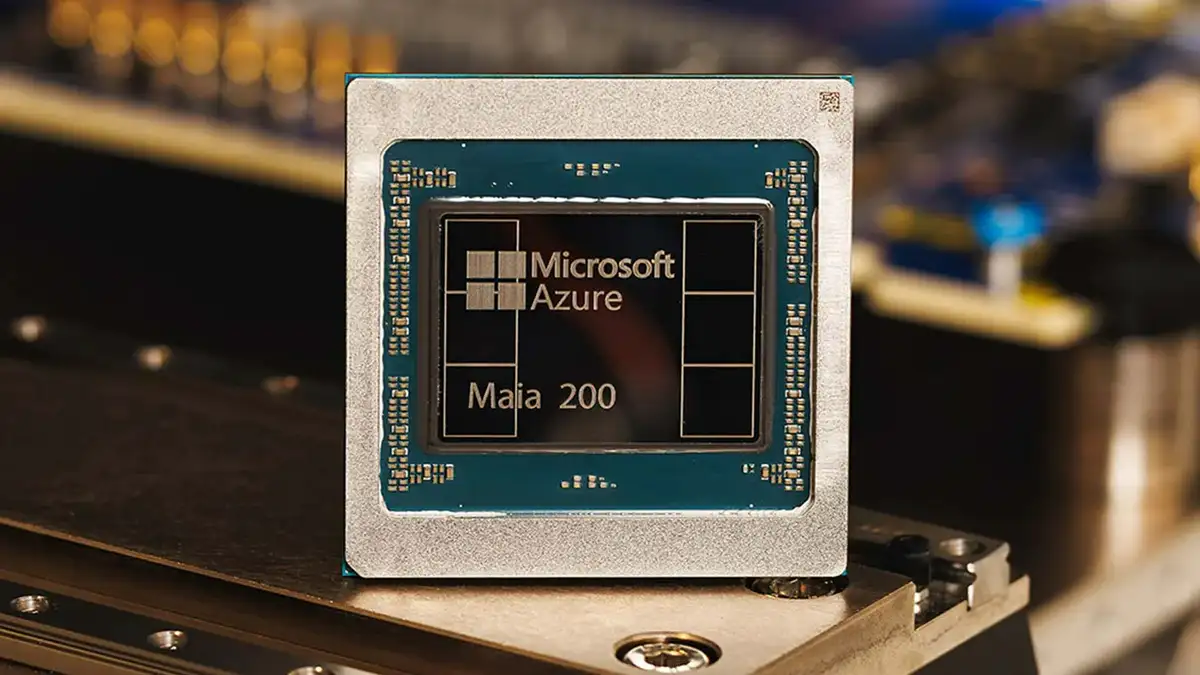

Microsoft Maia 200 Chip und technische Spezifikationen

Microsofts KI-Prozessor der nächsten Generation, der Maia 200, zieht mit seinen technischen Daten alle Blicke auf sich. Da es sich nicht um ein Endverbraucherprodukt handelt, wurde dieser Chip ausschließlich für die anspruchsvollsten KI-Aufgaben in Microsofts riesigen Azure-Rechenzentren konzipiert. Eines der herausragendsten Merkmale ist, dass er im 3-nm-Fertigungsprozess von TSMC, einer der fortschrittlichsten Produktionstechnologien der Branche, hergestellt wird. Diese Technologie ermöglicht es dem Chip, eine höhere Leistung bei gleichzeitig deutlich verbesserter Energieeffizienz zu bieten.

Hinter der Leistung des Maia 200 steht eine weitere beeindruckende Zahl: die Anzahl der Transistoren. Mit insgesamt 100 Milliarden Transistoren verfügt dieser Chip über die Kapazität, die komplexesten und größten KI-Modelle von heute reibungslos auszuführen. Microsoft präsentiert zudem ehrgeizige Leistungsdaten im Vergleich zu Konkurrenzlösungen:

- Dreimal höhere FP4-Leistung im Vergleich zum Trainium-Chip der dritten Generation von Amazon.

- Bessere FP8-Leistung als der TPU-Prozessor (Tensor Processing Unit) der siebten Generation von Google.

Diese Leistungsmetriken sind entscheidend für die Erhöhung der Geschwindigkeit und Effizienz beim Training und Betrieb großer Sprachmodelle durch Berechnungen mit geringerer Präzision. Microsoft betont, dass der Maia 200 wesentlich effizienter arbeitet als die Vorgängergeneration Maia 100 und bereits für die noch größeren KI-Modelle der Zukunft gerüstet ist.

Strategischer Schachzug für OpenAI und GPT-5.2

Eine der größten Motivationen hinter der Entwicklung des Maia 200 Chips ist zweifellos die tiefe strategische Partnerschaft mit OpenAI. Microsoft hat offiziell bestätigt, dass dieser neue Chip zum Trainieren und Ausführen des GPT-5.2 Modells verwendet wird, das als eines der fortschrittlichsten zukünftigen Modelle von OpenAI erwartet wird. Dies unterstreicht Microsofts Engagement, seinem wichtigsten Partner die beste Infrastruktur zur Verfügung zu stellen. Die Nutzung eines eigenen, spezialisierten Chips bietet Microsoft sowohl Kostenvorteile als auch die volle Kontrolle über die Performance.

Darüber hinaus wird der Einsatzbereich des Maia 200 nicht auf OpenAI beschränkt sein. Dieser leistungsstarke Chip wird auch Microsofts eigene Produkte und Dienste unterstützen. Insbesondere Produktivitätswerkzeuge wie Microsoft 365 Copilot ve die über die Microsoft Foundry-Plattform angebotenen KI-Modelle werden von der Rechenkraft des Maia 200 profitieren. Diese Integration wird die Geschwindigkeit und die Fähigkeiten der KI-gestützten Dienste für Unternehmens- und Privatkunden direkt steigern.

Microsofts Maia 200-Vorstoß ist Teil eines breiteren Trends in der Technologiebranche. Giganten wie Google (TPU), Amazon (Trainium, Inferentia) und Meta entwickeln ebenfalls seit langem eigene KI-Chips. Dieser Wettbewerb basiert auf dem Wunsch, die Abhängigkeit von externen Lieferanten wie Nvidia zu verringern, Kosten zu senken und die Hardware perfekt auf die eigene Software abzustimmen. Der Maia 200 verdeutlicht Microsofts Entschlossenheit, die Zukunft seiner KI-Infrastruktur eigenständig zu gestalten.

Zusammenfassend lässt sich sagen, dass der Microsoft Maia 200 Chip als Motor fungieren wird, der die Wettbewerbsfähigkeit von Azure stärkt und die Grenzen der Dienste von OpenAI und Microsoft weiter verschiebt.