Es hat sich herausgestellt, dass Nvidia für die in diesem Jahr geplante Vera Rubin AI-Plattform eine kritische Änderung bei den Speicheranforderungen vorgenommen hat. Branchenquellen zufolge hatte das Unternehmen das ursprüngliche HBM4-Geschwindigkeitsziel von 9 Gbps zunächst auf einen Bereich von 10-11 Gbps angehoben. Jüngste Gerüchte deuten jedoch darauf hin, dass diese Anforderung nun wieder gesenkt wurde.

HBM4-Geschwindigkeiten nach unten korrigiert

Hinter dieser Entscheidung sollen Lieferengpässe stecken. Es wird gemunkelt, dass Nvidia das benötigte HBM4-Gesamtvolumen nicht erreichen könnte, wenn die extrem hohen Geschwindigkeitsspezifikationen beibehalten würden. Aktuellen Prognosen zufolge wird erwartet, dass SK hynix etwa 70 % und Samsung 30 % des HBM4-Bedarfs für Rubin decken werden. Micron wird in der ersten Phase voraussichtlich nicht in der Lieferkette vertreten sein.

Die Senkung der HBM4-Geschwindigkeitsanforderungen könnte die Produktionsausbeute erhöhen und sicherstellen, dass mehr Chips die akzeptablen Standards erfüllen. Dies würde Nvidia insbesondere bei großvolumigen Aufträgen für Rechenzentren entlasten. Andererseits schließen einige Analysten die Möglichkeit nicht völlig aus, dass Micron bei entstehenden Lücken doch noch einspringen könnte.

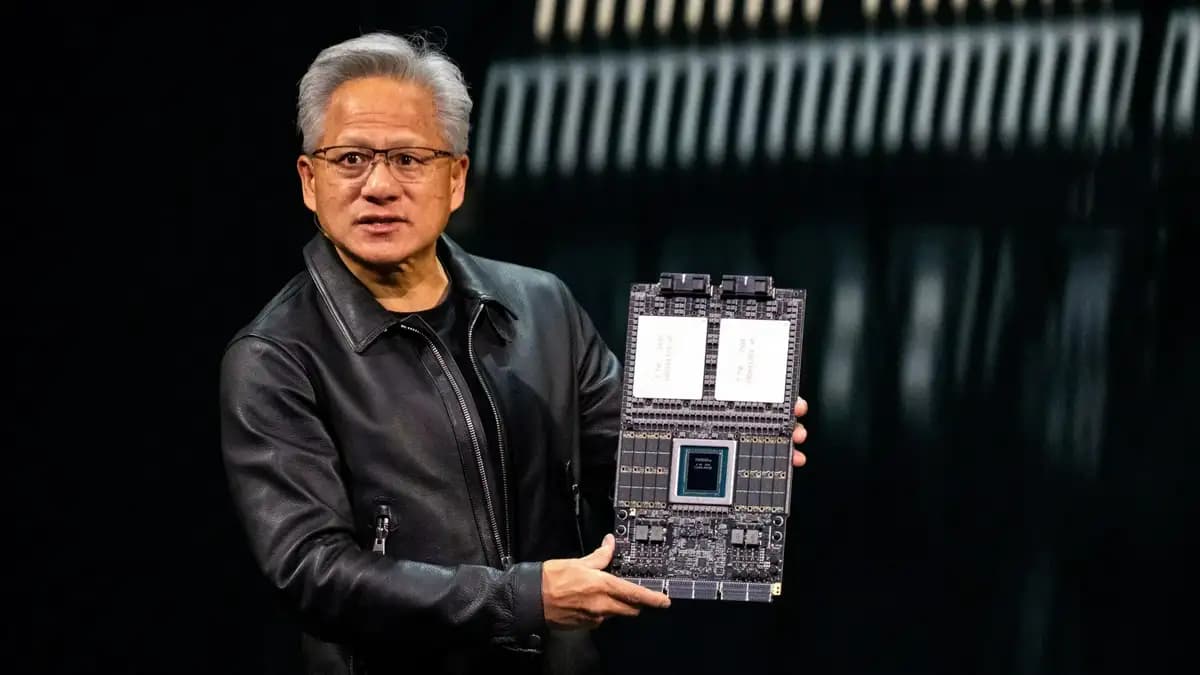

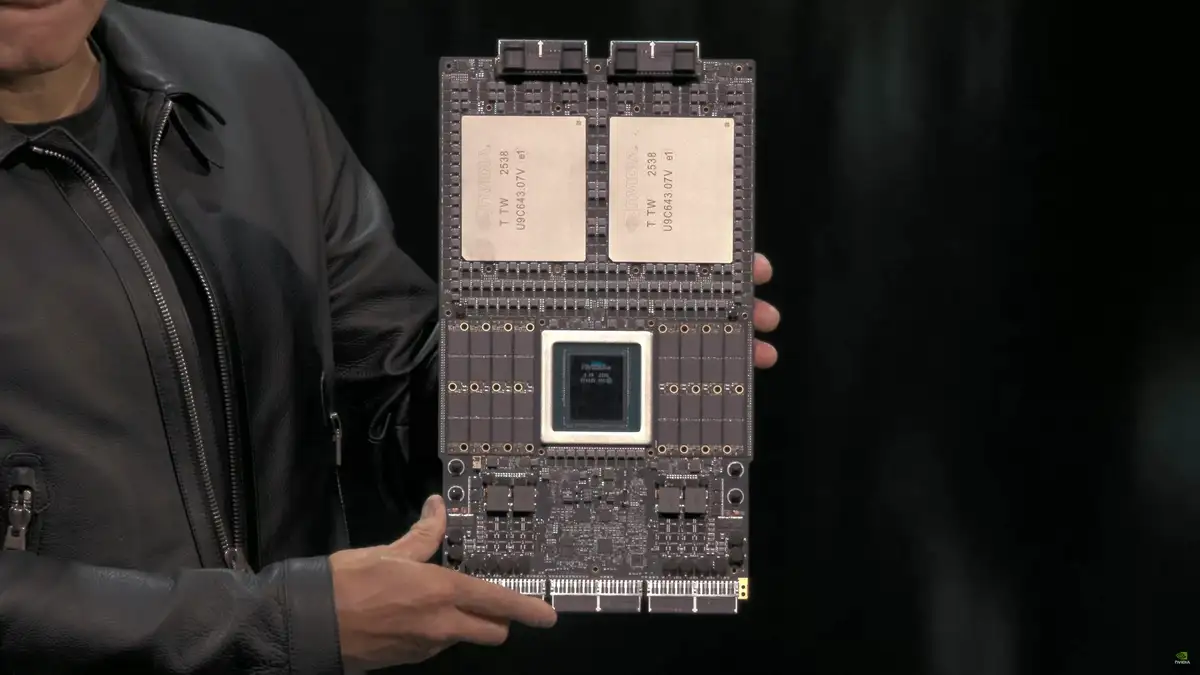

Die Rubin-Plattform, bestehend aus der neuen Vera-CPU, der Rubin-GPU und der HBM4-Speicherkombination, gilt als der nächste große Schritt des Unternehmens im Bereich der künstlichen Intelligenz. Es scheint jedoch, dass die Versorgungssicherheit in dieser Generation ebenso entscheidend sein wird wie die reine Performance. In einer Zeit, in der die KI-Nachfrage ihren Höhepunkt erreicht, ist die Speicherversorgung zu einem ebenso kritischen Faktor wie architektonische Innovationen geworden.